Vitis AI

- 设计工具

- Vitis 统一软件平台

- Vitis AI

从边缘到云的最佳人工智能推断

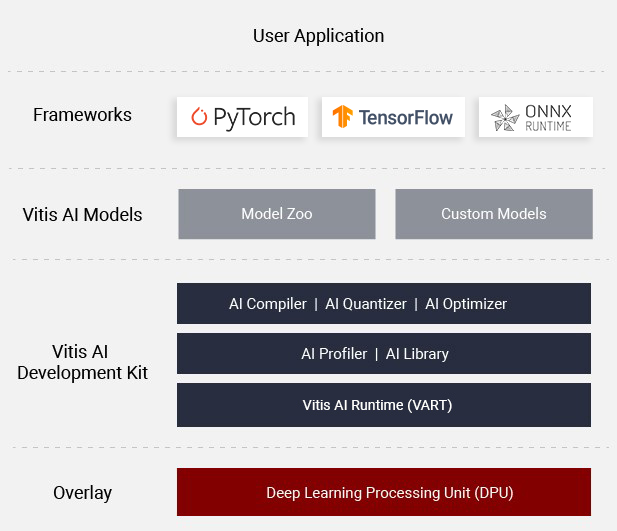

Vitis™ AI 软件是一款全面的 AI 推断开发解决方案,适用于 AMD 器件、开发板、Alveo™ 数据中心加速卡、选型 PC、笔记本电脑和工作站。它包括一系列丰富的 AI 模型、优化的深度学习处理器单元 (DPU) 内核、工具、库与示例设计,可充分满足边缘、端点和数据中心的 AI 需求。它的设计考虑了高效率和易用性,在 AMD 自适应 SoC 和RyzenTM AI 支持的 PC 上充分发挥 AI 加速的潜力。

图 1:Vitis AI 结构

如何使用 Vitis AI 软件进行开发:

- 支持主流框架和最新模型,能够进行多种深度学习推理、CNN 和生成大语言模型

- 功能强大的量化器和优化工具可实现优化的模型精度和处理效率

- 便捷的编译流程和高层次 API 可实现自定义模型的极速部署

- 可配置的高效率 DPU 内核能够充分满足边缘、端点及云端对吞吐量、时延、和功耗的不同需求

使用 Vitis AI 探索一切可能性

图 2:模型专区

AI 模型库

AI Model Zoo 向所有用户开放,在 PyTorch、TensorFlow 和 ONNX 中提供丰富现成的深度学习模型。AI 模型专区提供可重复训练的优化 AI 模型,其可通过 AMD 平台实现更快的执行、性能加速和生产。

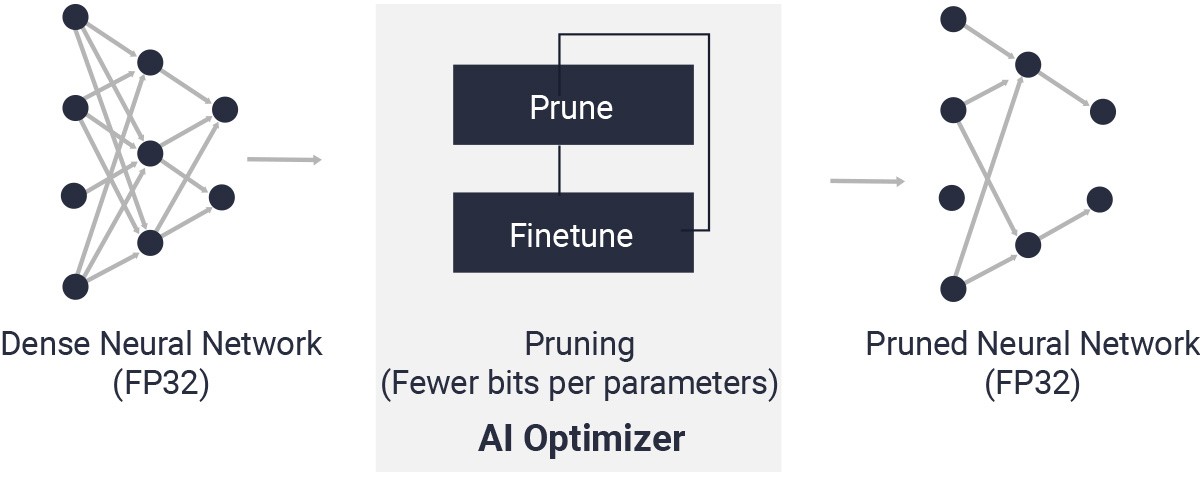

AI 优化器

有了优异的模型压缩技术,AI 优化器可在对精度影响极小的情况下,将模型的复杂性降低 5 至 50 倍。深度压缩可将您的 AI 推断性能提升到一个新的层次。

图 3:Vitis AI 优化器

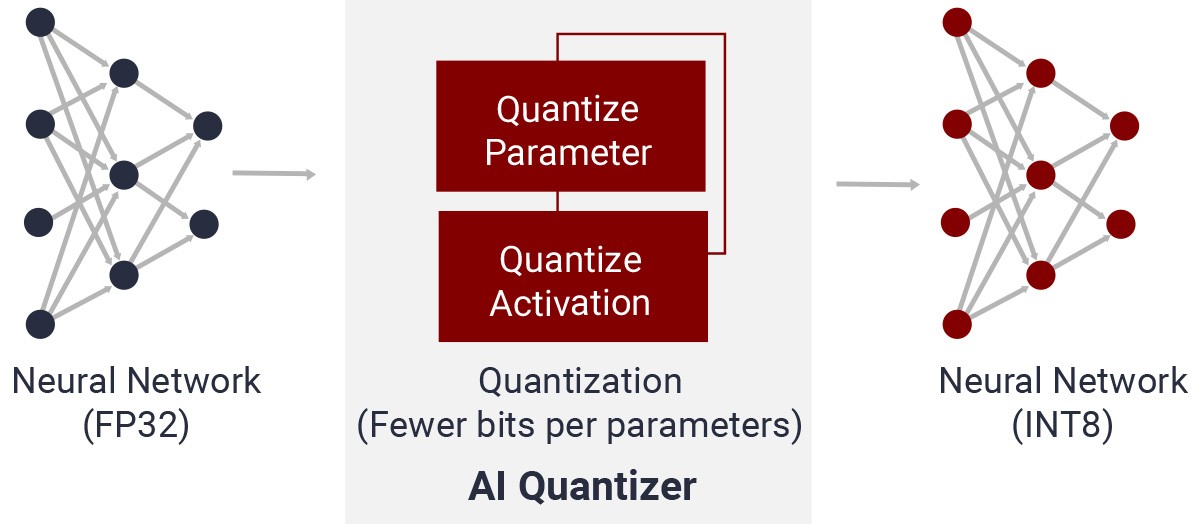

图 4:Vitis AI 量化器

AI 量化器

一个自定义运算符检查、量化、校准、微调以及将浮点模型转换为需要更少内存带宽的定点模型的完整过程,不仅可提供更快的速度,而且还可提供更高的计算效率。

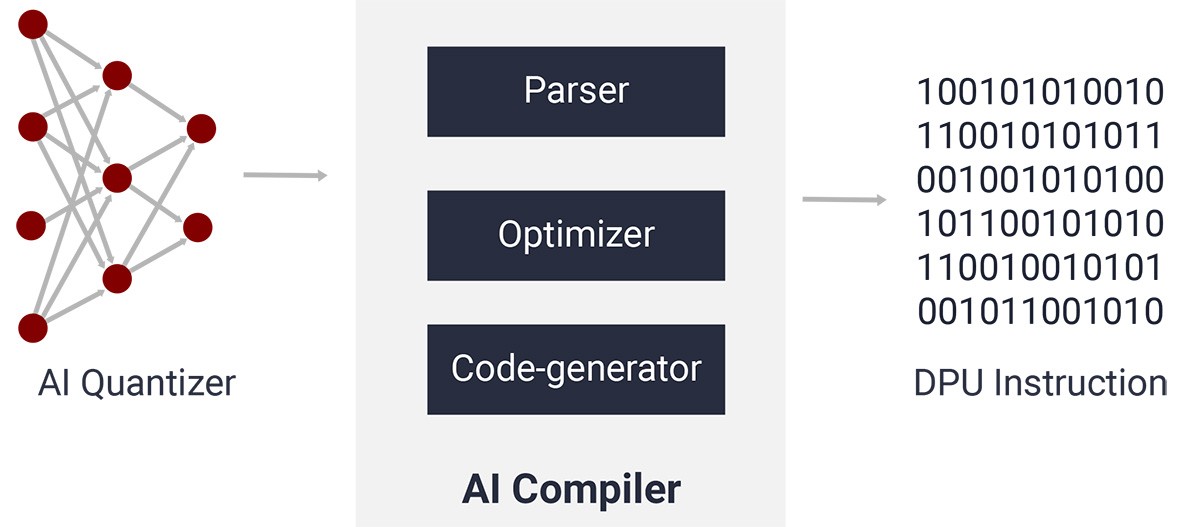

AI 编译器

AI 编译器可将 AI 模型映射至高效指令集及数据流程。此外,它还可执行层融合和指令排程等高级优化任务,并可尽量重复使用片上内存。

图 5:Vitis AI 编译器

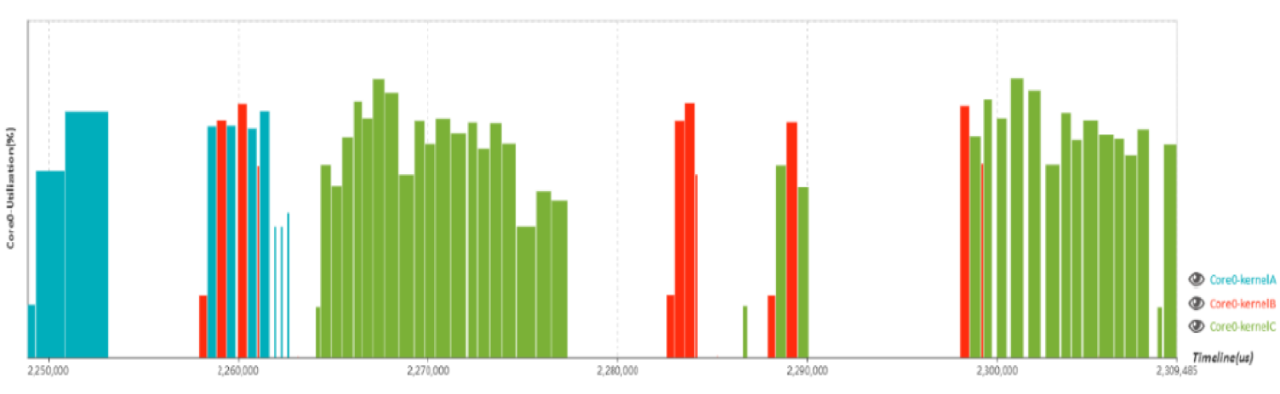

AI 剖析器

性能剖析器有助于程序员深入分析 AI 推断实现方案的效率和利用率。

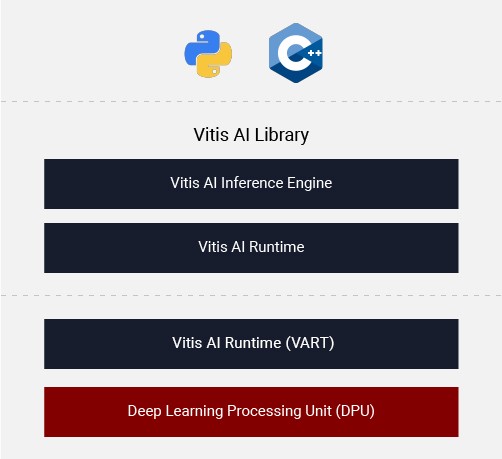

AI 库

Vitis AI 库是一组高层次库和 API,旨在通过 DPU 核进行有效的 AI 推断。它建立在支持统一 API 的 Vitis AI 运行时 (VART) 基础之上,可为 AMD 平台上的 AI 模型部署提供简单易用的接口。

图 7:Vitis AI 库

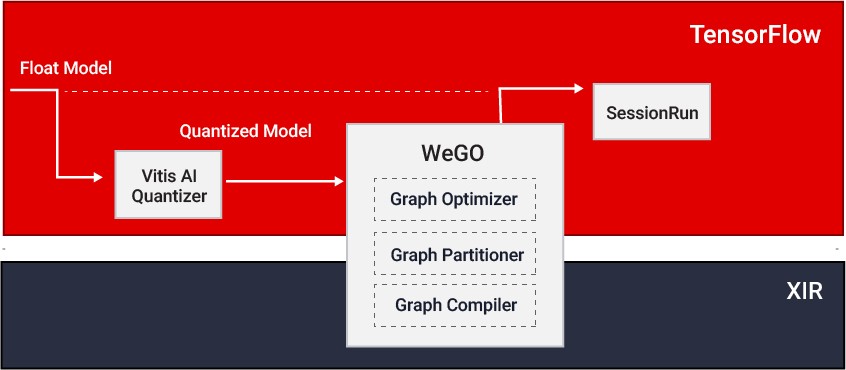

图 8:Vitis AI 编译器

全图形优化器 (WeGO)

WeGO 框架推断流程提供一条从训练到推断的直接路径,可利用本地 TensorFlow 或 PyTorch 框架将 DPU 不支持的运算符部署到 CPU 中,从而可显著加速通过云 DPU 执行的模型部署与评估。

深度学习处理器

DPU 是一种灵活应变的特定领域架构 (DSA),可与基于 CNN 和 Transformer 模型的 AI 算法相匹配,并拥有 AMD 自适应 SoC、Alveo 数据中心加速器卡和选型 Ryzen AI PC 的行业领先性能 。

边缘部署

Vitis™AI 软件不仅可为边缘设备提供支持优化算法的强大计算性能,同时还可凭借优化的功耗实现部署的高灵活性。它可为汽车、工业、医疗以及视频分析等普及型边缘应用提高计算性能。

客户端部署

AMD Ryzen™ 7040 系列移动处理器采用 AMD XDNA™ 架构构建,助力加速多任务处理、提升生产力、效率和高级协作。

本地部署

有了 Vitis AI 解决方案的支持,Alveo™ 数据中心加速卡可为 CNN、RNN 及 NLP 上的不同工作负载提供极具竞争力的 AI 推断性能。开创性本地 AI 解决方案旨在满足现代数据中心对超低时延、更高吞吐量以及高灵活性的需求,可通过 CPU、GPU 以更低总体拥有成本提供更高计算性能。

云部署

通过与 AWS 和 VMAccel 等公共云服务提供商合作,AMD 现在可提供对 FPGA 和 Versal™ 自适应 SoC 云实例的远程访问,从而能够快速启动模型部署,即使没有本地软硬件也没问题。

Vitis AI 平台文档

现已为在模型、工具以及深度学习处理器单元等上使用 Vitis™AI 平台开发提供广泛的文档支持。

链接至以下特定文档或访问文档门户网站,查看所有 Vitis AI 平台文档。

助力自动驾驶和 ADAS 技术

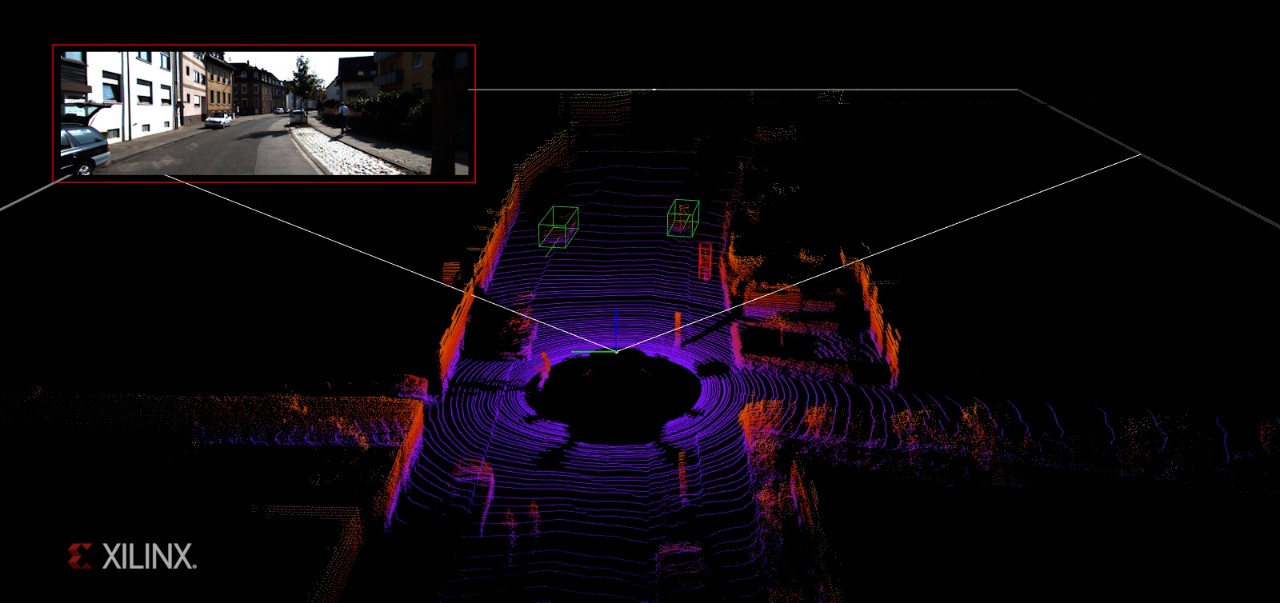

实时多类 3D 对象检测

借助 Vitis™ AI,您可在嵌入式平台上使用 3D 感知 AI 算法实现实时处理。硬件和软件加速的共同优化实现了 Zynq™ UltraScale+™ MPSoC 上最新 PointPillars 模型的领先性能。

观看视频 >

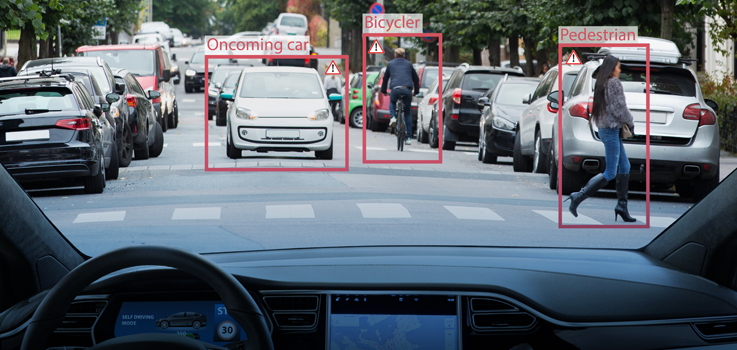

面向自动驾驶的超低延时应用

延迟决定了自动驾驶汽车在高速行驶时和遇到障碍物时的决策。通过创新的领域特定加速器和软件优化,Vitis AI 使自动驾驶汽车能够以超低延迟和更高性能来处理深度学习算法。

对象检测与分割

Vitis AI 具有强大的可扩展性和自适应性,可适用于许多低端到高端的 ADAS 产品,提供业界领先的性能,支持流行的 AI 算法,用于前端 ADAS 中的对象检测、车道检测和分段以及车内或环绕声查看系统。

使城市更智能、更安全

视频分析

城市越来越多地在边缘点和云端采用基于智能的系统。每天生成的海量数据需要强大的端到端 AI 分析系统,以便快速检测和处理对象、流量和面部行为。这为从边缘到云的每个框架增加了宝贵的见解。

详细了解AMD 机器和计算机视觉 >

利用人工智能的强大力量以提升健康

本地及数据中心中的 AI

数据中心加速

详细了解AMD 数据中心 >

重要视频

所有视频

开始设计

嵌入式平台开发

步骤 1:设置硬件平台

步骤 2:从 GitHub 下载并安装 Vitis AI™ 环境

步骤 3:使用 VART 和 AI 库运行 Vitis AI 环境示例

步骤 4:访问教程、视频等

如需了解更多嵌入式开发的信息,请点击以下按钮: